Regreso (statistiko)

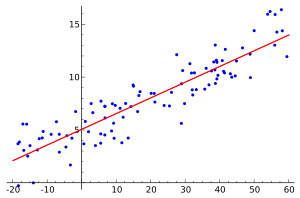

Regreso estas unu el aro da statistikaj metodoj tre uzataj por analizi rilaton de dependa variablo al unu aŭ pluraj aliaj sendependaj variabloj. Pli specife, regreso helpas komprenigi, kiel tipa valoro de dependa variablo ŝanĝas, kiam unu el la sendependaj variabloj varias, dum la aliaj sendependaj variabloj restas senŝanĝaj.

Regresanalizo estas vaste uzata por prognozo kaj antaŭvido, kiam la laborkampo proksimiĝas al artefarita intelekto.

Granda aro da teĥnikoj por trakti analizojn estis realigitaj. Konataj metodoj, kiel la lineara regreso kaj la metodo de kvadrataj minimumoj, estas parametraj regresoj, ĉar ilia regresofunkcio, kiu bildigas la problemon, estas difinita per finia nombro da nekonataj parametroj, kiuj estas laŭtaksataj el la datenoj. Neparametraj regresoj estas malpli konataj, kaj rilatas al teĥnikoj, kiuj permesas regresojn ligitajn al specifa aro da funkcioj, kun okazeble nefiniaj dimensioj.

Historio[redakti | redakti fonton]

La plej frua formo de regreso estis la metodo de kvadrataj minimumoj (france: méthode des moindres carrés), kiu estis publigita fare de la matematikistoj Adrien-Marie Legendre en 1805[1], kaj de Carl Friedrich Gauss en 1809[2] . Li ambaŭ uzis la metodon por la problemo kiel determini, el astronomiaj observaĵoj, la orbitojn de korpoj ĉirkaŭ la suno. Gauss publikigis pluevoluigon de la teorio de kvadrataj minimumoj en 1821[3].

La termino "regreso" estis kreita de la brita scienculo Francis Galton, en la deknaŭa jarcento, por priskribi biologian fenomenon. Tia fenomeno estis la observado kiel la alto de posteuloj de altaj prapatroj tendencas regresi (malkreski) al normala meznombro (fenomeno ankaŭ konata kiel regreso al laŭnorma).[4][5] Por Galton, regreso havis nur tiun biologian signifon[6][7], sed lia laboro estis poste etendita fare de Udny Yule and Karl Pearson al pli ĝenerala statistika kunteksto[8][9]. En la laboro de Yule kaj Pearson, la komuna distribuo de la respondo kaj de la eksplikvariabloj estas supozita esti gaŭsa. Tiu supozo estis malfortigita fare de Ronald A. Fisher en liaj verkoj de 1922 kaj 1925[10][11][12]. Fisher supozis, ke la kondiĉa distribuo de la respondovariablo estu gaŭsa, sed ne estu la komuna distribuo. Laŭ tiu aspekto, la supozo de Fisher estas pli proksima al la 1821-a formulado de Gauss.

Regresmetodoj daŭre estas areo da aktiva esplorado. En lastatempaj jardekoj, novaj metodoj estis evoluigitaj por fortika regreso: regreso kiu implicas korelaciitajn respondojn, kiel ekzemple temposerioj kaj kreskokurboj, regreso pri kiu prognozilo aŭ respondovariabloj estas kurboj, bildoj, grafeoj aŭ aliaj kompleksaj datumobjektoj, regresmetodoj alĝustigante diversajn specojn de mankaj datenoj, neparametra regreso, Bayesaj metodoj (laŭ la nomo de matematikisto Thomas Bayes), regresoj en kiuj la prognozilovariabloj estas laŭmezuraj kun eraroj, regreso kun pli da prognozilovariabloj ol observaĵoj, kaj kaŭza inferenco kun regreso.

Regresomodeloj[redakti | redakti fonton]

Regresomodeloj implicas la sekvantajn variablojn:

- La nekonataj parametroj, notataj β, kiuj povas esti skalaro aŭ vektoro.

- La sendependaj variabloj, X.

- La dependa variablo, Y.

En diversaj kampoj, malsamaj terminologioj estas uzitaj anstataŭ dependaj kaj sendependaj variabloj.

Regresomodelo rilatigas Y al funkcio de X kaj β.

La aproksimado estas kutime formaligita tiel E(Y | X) = f(X, β). Por trakti regresanalizon, la formo de la funkcio f devas esti precizigita. Foje la formo de tiu funkcio estas bazita sur scio pri la rilato inter Y kaj X, kiu ne originas de la datenoj. Se tia scio ne haveblas, fleksiĝema kaj oportuna formo por f estas elektita.

Supozu nun, ke la vektoro de nekonataj parametroj β estas je longo k. Por plenumi la regresanalizon la uzanto devas konsideri informojn pri la dependa variablo Y:

- Se N datenparoj (Y,X) estas observitaj, kie N < k, la plej klasikaj metodoj por regresanalizo ne povas esti aplikataj: ĉar la sistemo de ekvacioj difinante la regresomodelon estas subdeterminita, ekzistas ne sufiĉe da datenoj por bildigi β.

- Se precize N = k datenparoj estas observitaj, kaj la funkcio f estas lineara, la ekvacioj Y = f(X, β) povas esti precize solvataj. Tio reduktas solvi aron da N ekvacioj kun N nekonataĵoj (la elementoj de β), kiu havas unikan solvon, konsiderante ke la X estas lineare sendependaj. Se f estas nelineara, eblas ke solvo ne ekzistas, aŭ multaj solvoj povas ekzisti.

- La plej ofta situacio estas kiam N > k datenparoj estas observitaj. Pri tia kazo, ekzistas sufiĉe da informoj en la datenoj por taksi unikajn valorojn al β, kiuj plej bone kongruas kun la datenoj, kaj la regresomodelo, kiam aplikata al la datenoj, povas esti rigardata kiel superdeterminita sistemo pri β.

Rilante la lastan kazon, regreso disponigas ilojn por:

- trovi solvon por nekonataj parametroj β, kiuj, ekzemple, minimumigas la ekartojn inter la laŭmezuraj kaj antaŭdiritaj valoroj de la dependa variablo Y (ankaŭ konata kiel metodo de kvadrataj minimumoj);

- sub apartaj supozoj, la regreso uzas la kroman informon por trakti statistikan informon pri la nekonataj parametroj β, kaj pri la antaŭdiritaj valoroj de la dependa variablo Y.

Necesa nombro da sendependaj mezuroj[redakti | redakti fonton]

Konsideru regresomodelon, kiu havas tri nekonatajn parametrojn, β0, β1, kaj β2. Supozu, ke eksperimentisto traktas 10 mezurojn, ĉiujn kun precize la sama valoro de la sendependa variablovektoro X (kiu enhavas la sendependajn variablojn X1, X2, kaj X3). Pri tiu kazo, la regresanalizo ne donas unikan aron da laŭtaksaj valoroj por la tri nekonatoj parametroj; la eksperimentisto ne akiris sufiĉe da informoj. La nura plej bona traktado estu taksi la mezvaloron kaj la norman diferencon de la dependa variablo Y. Simile, se mezuroj kun du malsamaj valoroj de X donus sufiĉe da datenoj pri regreso kun du nekonataĵoj, ili ne sufiĉus pri tri aŭ pli nekonataĵoj. Se la eksperimentisto estus traktinta mezurojn kun tri malsamaj valoroj de la sendependa variablovektoro X, tiam la regresanalizo disponigus unikan aron da taksoj por la tri nekonataj parametroj de β.

Koncerne ĝeneralan linearan regreson, ĉiusupra deklaro estas ekvivalenta al la neprigo, ke la matrico estu inversigebla ( estas la transponita matrico de la matrico , kies elementoj estas la aro de la N vektoroj X).

Statistikaj supozoj[redakti | redakti fonton]

Kiam la nombro de mezuroj, N, estas pli granda ol la nombro de nekonataj parametroj, k, kaj la mezureraroj estas normale distribuitaj, tiam la eksceso de informoj enhavita en la kromaj (N - k) mezuroj permesas fari statistikajn prognozojn pri la nekonataj parametroj. Tiu eksceso da informoj estas referencata kiel la gradoj de libereco de la regreso.

Subestantaj supozoj[redakti | redakti fonton]

Klasikaj supozoj por regresanalizo inkludas la sekvantajn.

- La specimeno valide reprezentas la loĝantaron por inferencoprognozo.

- La eraro estas hazarda variablo kun averaĝa nul-kondiĉo sur la eksplikvariabloj.

- La sendependaj variabloj estas mezuritaj kun neniu eraro. (Notu: se tio ne estas tiel, modeligado povas esti farita anstataŭe per uzo de taŭgaj modeloj pri variabloj kun eraroj).

- La prognoziloj estas lineare sendependaj, tio estas, ne eblas esprimi ajnan prognozilon per lineara kombinaĵo de la aliaj.

- La eraroj estas ne-korelaciitaj, t.e. la matrico de varianco-kunvarianco de la eraroj estas diagonala, kaj ĉiu ne-nula elemento estas la varianco de la eraro.

- La varianco de la eraro estas konstanta por ĉiu observita variablo. (Notu: se ne, oni povas anstataŭe trakti la metodon de laŭpezaj kvadrataj minimumoj aŭ aliajn metodojn).

Ili estas sufiĉaj kondiĉoj al la prognozo per la kvadrataj minimumoj por permesi dezirindajn trajtojn, aparte, tiaj supozoj implicas, ke la parametrotaksoj estos senantaŭjuĝaj, koheraj, kaj efikaj en klaso de linearaj senantaŭjuĝaj prognozo. Gravas noti, ke faktaj datenoj malofte konformiĝas al la supozoj; tio estas, la metodo estas uzata eĉ se la supozoj ne veras. Vario de la supozoj povas foje esti utiligata por taksi la plej taŭgan solvon. Raportoj pri statistikaj analizoj kutime inkludas analizojn de testoj pri la specimenaj datenoj kaj metodologion pri la utileco de la modelo.

Lineara regreso[redakti | redakti fonton]

En lineara regreso, la modelospecifo estas, ke la dependa variablo, , estas lineara kombinaĵo de la parametroj (sed malnepre estu lineara en la sendependaj variabloj). Ekzemple, pri la lineara polinoma regreso por modeligado de datenpunktoj ekzistas unu-dependa variablo , kaj parametroj ĝis , kaj rezultas:

(Notu: en multobla lineara regreso, estas pluraj sendependaj variabloj aŭ pluraj funkcioj de sendependaj variabloj).

La plej simplaj linearaj regresoj estas:

per aldono de unu termo de grado 2, xi2, al la antaŭa regreso rezultas

Tiu kvadrata funkcio estas ankoraŭ lineara regreso; malgraŭ ke la esprimo enhavas kvadratan termon rilatante al la sola sendependa variablo , ĝi estas lineara pri la parametroj , kaj

Pri ambaŭ kazoj, estas erartermo, kaj la indico indikas apartan observon.

Konsiderante hazardan specimenon el loĝantaro, ni taksas la loĝantarparametrojn, kaj tiel akiras la specimenan linearan regresomodelon:

La restaĵo, , estas la diferenco inter la valoro de la dependa variablo antaŭdirita fare de la modelo, , kaj la observita valoro de la dependa variablo, . Unu metodo de taksado estas la ordinara metodo de kvadrataj minimumoj. Ĝi akiras la parametrojn, kiuj minimumigas la sumon de kvadrataj restaĵoj, SKR ,[13][14]:

Minimumigo de tia funkcio gvidas al aro da ekvacioj, kiuj estas solvitaj por doni la parametrotaksojn: kaj .

Koncerne simplan regreson, la formuloj por la taksoj per la plej malgrandaj kvadratoj estas:

kie estas la meznombro (averaĝo) de la valoroj, kaj estas la meznombro de la valoroj, estas la specimena korelaciokoeficiento rilate al kaj , estas la specimena varianca devio de , and estas respektive la specimena varianca devio de . Horizontala baro super variablo signas specimenan averaĝon de tiu variablo; ekzemple,

Anstataŭante la ĉisuprajn esprimojn pri and en la ekvacio de la rekto

kondukas al:

Tio indikas la rolon, kiun ludas pri la regresrekto.

Sub la supozo, ke la termo de eraro pri la loĝantaro havas konstantan variancon, la takso de la varianco estas kalkulata per:

Tiu estas nomita averaĝa kvadrata eraro de la regreso.

La normaj eraroj de la taksoj de parametroj estas kalkulataj per:

Sub la plia kondiĉo, ke la termo de eraro pri la loĝantaro estas normale distribuita, esplorlaboranto povas uzi tiajn laŭtaksajn normajn erarojn, por krei fidointervalojn kaj implici hipotezotestojn pri la parametroj de la loĝantaro.

Ĝenerala lineara modelo[redakti | redakti fonton]

Pri pli ĝenerala multobla regresomodelo, estas p sendependaj variabloj:

kie estas la i-a observo de la j-a sendependa variablo, kaj kie la unua sendependa variablo valoras 1 por ĉiu i (nur kiel unua termo) .

La takso de la parametroj per la plej malgrandoj kvadratoj akiriĝas per p normalaj ekvacioj; eblas skribi la restaĵoj tiel:

Por tio, oni elektas la sekvantan funkcion:

kiun oni minimumigas per kalkulo de ĝia derivaĵo. La kialo por elekti tiun kriterion estas, ke la problemo, kondiĉe ke la n kolumnoj de la matrico estu lineare sendependaj, kondukas al unika solvo de la sekvantaj normalajn ekvaciojn:

laŭ matrica skribado, ili estas formulataj tiel:

kie la ij elemento de estas , la i elemento de la kolumna vektoro estas , kaj la j elemento de estas . Tial la respektivaj dimensioj de , kaj estas n×p, n×1 kaj p×1. Kaj la solvo estas:

Interpolado kaj ekstrapolado[redakti | redakti fonton]

Regresomodeloj antaŭdiras valoron de la Y variablo koncerne konatajn valorojn de la X variablo. Prognozo ene de la intervalo de valoroj en la datenaro, kiuj estas uzitaj por alĝustiga modelo estas konata neformale interpolado. Prognozo ekster tiu vico de datenoj estas konata kiel ekstrapolado.

La plej konataj interpolaj metodoj estas la lineara interpolo kaj la polinoma interpolo, sed estas aliaj nelinearaj interpoloj (ekz. splina interpolo, kurbo de Bézier, polinomo de Lagrange, ktp).

Estas ĝenerale konsilite, ke, dum traktado de ekstrapolado, oni akompanu la laŭtaksan valoron de la dependa valoro kun prognozintervalo, kiu limigas la necertecon. Tiaj intervaloj tendencas disetendiĝi rapide kiam la valoroj de la sendependa(j) variablo(j) eksteriĝas el la intervalo de la observitaj datenoj.

Efikeco de la ekstrapolado forte dependas de la regresosupozoj. Ju pli la ekstrapolado iras ĝis fore ekster la datenaro, des pli estas risko de la modelo malsukcesi, pro differencoj inter la supozoj kaj la specimenaj datenoj aŭ la veraj valoroj.

Pro tiaj kialoj kaj aliaj, iuj tendencas diri ke estu malprudenta entrepreni ekstrapoladon[15].

Tamen, tio ne kovras la tutan aron de erarmodeligado, kiu eblas: aparte, la supozo de speciala formo por la rilato inter Y kaj X. Konvene kondukita regresanalizo inkludos takson de kiom bone la supozita formo kongruas kun la observitaj datenoj, sed oni povas nur fari tion ene de la intervalo de valoroj de la sendependaj variabloj fakte disponeblaj. Tiu scio inkludas la fakton, ke la dependa variablo ne povas estis ekster aparta vico da valoroj. Tielmaniere, ĉia ekstrapolado aparte fidas al la antaŭsupozoj pri la struktura formo de la regresrilato. La implicoj de tiu paŝo por elekti taŭgan funkcian formon de la regreso povas esti bonegaj, kiam ekstrapolado estas entreprenata. Minimume, tio certigas, ke tia ekstrapolado ekestiĝanta de alĝustigita modelo estas realisma (aŭ en akordo kun kio estas konita).

Nelineara regreso[redakti | redakti fonton]

Kiam la procezo ne estas lineara rilate al la parametroj, (la parametroj estas funkcioj dependaj de X aŭ ne, ekz. , ktp), modelofunkcio aproksimiĝas per tia ŝajna lineara funkcio:

- ,

kie . La nelinearaj regresoj estas kalkulitaj kvazaŭ linearaj regresoj, pri kiuj X anstataŭiĝis per J, variablo dependa de ambaŭ X kaj .

Algoritmoj por trovi solvon de nelineara regreso necesas elektadon de iniciatitaj parametrovaloroj (kio ne necesas pri lineara regreso). Konsekvente, la parametroj estas alĝustigitaj per ripeta procedo:

- ,

k estas ripeta nombro kaj la vektoro de aldonitaĵoj.

Pri kelkaj komunaj algoritmoj, en ĉiu k-a kalkulo la modelo estas lineare aproksimata per serio de Taylor de unua ordo rilate al :

La Jakobia matrico, J, estas funkcio de konstantoj, nedependaj variabloj kaj parametroj, do ĝi ŝanĝas de unu ripeta kalkulo al la sekvanta. La restaĵoj estas donitaj per:

- .

Por minimumigi la sumon de la kvadratoj de , la ekvacio de la derivaĵo estas nuligita por :

- ,

kio, post aranĝo, iĝas m samtempaj linearaj ekvacioj, la normalaj ekvacioj.

La normalaj ekvacioj estas formulataj laŭ matrica skribado tiel:

Kontraŭe al linearaj regresoj, eblas ke ekzistas pluraj solvoj por la parametroj, kiuj nuligas la ĉisupra ekvacio de la derivaĵo.

Alia regresometodo estas segmenti la tutan studodomajnon; tiel oni elektas taŭgajn parametrojn en ĉiu segmento, kaj traktas linearan regreson por tiaj konsideritaj segmentoj (vidu ĉisupran interpoladon).

Vidu ankaŭ[redakti | redakti fonton]

Referencoj[redakti | redakti fonton]

- ↑ Adrien-Marie Legendre, Nouvelles méthodes pour la détermination des orbites des comètes (1805). “Sur la Méthode des moindres quarrés” (La metodo pri la kvadrataj minimumoj aperis kiel aldono al liaj Novaj metodoj por determini orbitojn de kometoj). (france)

- ↑ C.F. Gauss. Theoria Motus Corporum Coelestium in Sectionibus Conicis Solem Ambientum (Teorio de la movo de ĉielaj korpoj orbitantaj ĉirkaŭ la suno). (1809) (latine)

- ↑ C.F. Gauss. Theoria combinationis observationum erroribus minimis obnoxiae (Teorio de erarminimumigo ĉe observajoj). (1821/1823) (latine)

- ↑ Robert G. Mogull (2004). Second-Semester Applied Statistics (Aplika statistiko) (Editoro: Kendall/Hunt Publishing Company, paĝo 59). ISBN 0-7575-1181-3.

- ↑ (1989) “Kinship and Correlation ''(represita en 1989) Parenco kaj korelacio”, Statistical Science 4 (2), p. 80–86.

- ↑ Francis Galton, "Typical laws of heredity" (Leĝoj de heredeco), Nature 15 (1877), 492-495, 512-514, 532-533. (Galton uzas la terminon "reversion" en la artikolo, diskutante pri la dimensio de pizoj.)

- ↑ Francis Galton. Presidential address, Section H, Anthropology. (1885) (Galton uzas la terminon "regression" en la artikolo, diskutante pri la alto de homoj.)

- ↑ (1897) “On the Theory of Correlation (Pri la teorio de korelacio)”, J. Royal Statist. Soc. 60 (4), p. 812–54. doi:10.2307/2979746.

- ↑ (1903) “The Law of Ancestral Heredity (La leĝo de la prapatra heredeco)”, Biometrika 2 (2), p. 211–236. doi:10.1093/biomet/2.2.211.

- ↑ (1922) “The goodness of fit of regression formulae, and the distribution of regression coefficients (La valideco de la formuloj de regresoj)”, J. Royal Statist. Soc. 85 (4), p. 597–612. doi:10.2307/2341124.

- ↑ Ronald A. Fisher (1954). Statistical Methods for Research Workers (Statistikaj metodoj por esplorlaboristoj) (Oliver kaj Boyd (Edinburgo)). ISBN 0050021702.

- ↑ (2005) “Fisher and Regression (Fisher kaj regreso)”, Statistical Science 20 (4), p. 401–417. doi:10.1214/088342305000000331.

- ↑ M. H. Kutner, C. J. Nachtsheim, and J. Neter (2004), "Applied Linear Regression Models" (Aplikitaj linearaj regresmodeloj), 4th ed., McGraw-Hill/Irwin, Boston (p. 25)

- ↑ N. Ravishankar and D. K. Dey (2002), "A First Course in Linear Model Theory" (Unua kurso pri la teorio de lineara modelo), Chapman and Hall/CRC, Boca Raton (p. 101)

- ↑ Chiang, C.L, (2003) "Statistical methods of analysis"' (Statistikaj analiizometodoj), World Scientific. ISBN 981-238-310-7 - page 274 section 9.7.4 "interpolation vs extrapolation" (Interpolado kaj ekstrapolado

![{\displaystyle {\begin{aligned}{\widehat {\beta }}&={\frac {\sum _{i=1}^{n}(x_{i}-{\bar {x}})(y_{i}-{\bar {y}})}{\sum _{i=1}^{n}(x_{i}-{\bar {x}})^{2}}}={\frac {\sum _{i=1}^{n}{x_{i}y_{i}}-{\frac {1}{n}}\sum _{i=1}^{n}{x_{i}}\sum _{j=1}^{n}{y_{j}}}{\sum _{i=1}^{n}({x_{i}^{2}})-{\frac {1}{n}}(\sum _{i=1}^{n}{x_{i}})^{2}}}\\[6pt]&={\frac {{\overline {xy}}-{\bar {x}}{\bar {y}}}{{\overline {x^{2}}}-{\bar {x}}^{2}}}={\frac {\operatorname {cov} (X,Y)}{\operatorname {var} (X)}}=r_{xy}{\frac {s_{y}}{s_{x}}},\\[6pt]{\widehat {\beta _{0}}}&={\bar {y}}-{\widehat {\beta _{1}}}\,{\bar {x}}\ ,\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d2813c0d2f7447d79db5e5db0a907d745022a717)